AI 大模型基础

什么是 AI 大模型(LLM)

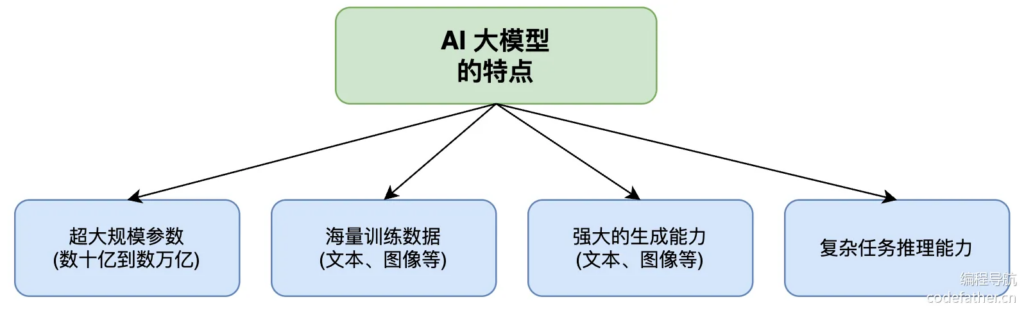

LLM 是大语言模型(Large Language Model) 的简称,是基于海量文本数据训练的深度学习模型,核心通过学习人类语言的语法、语义、逻辑和知识,实现自然语言理解(NLU) 和自然语言生成(NLG) 能力。

- 核心特征:参数量超大(从百亿到万亿级)、训练数据覆盖多领域文本、基于 Transformer 架构(自注意力机制是核心);

- 本质:通过统计规律和语义关联,对输入的语言进行概率化的合理续写,并非真正 “理解” 语言,是 “模式匹配 + 知识记忆” 的结合体。

Token 和上下文窗口

Token(令牌)

- 定义:大模型处理语言的最小单位,不是单纯的汉字 / 英文单词,一个汉字约 1-2 个 Token,一个英文单词约 1 个 Token,标点 / 空格也会占 Token;

- 作用:大模型的输入 / 输出均按 Token 计量,是模型计费、窗口限制的核心指标;

- 示例:“AI 大模型学习” 约 6 个 Token,“Hello World” 约 2 个 Token。

上下文窗口

- 定义:大模型能同时接收和处理的最大 Token 数量(输入 + 输出),是模型的 “记忆容量”;

- 分类:小窗口(如 GPT-3.5 4k)、中窗口(GPT-3.5 16k)、大窗口(Claude 3 Opus 200k+、GPT-4o 128k);

- 关键:窗口越大,能处理的长文本(论文、书籍、合同)越多,多轮对话不易丢失信息,但推理速度会变慢,成本会升高。

5. 流式输出(SSE)

- 定义:服务器发送事件(Server-Sent Events),是大模型的一种输出方式,指模型将生成的内容按片段、实时推送给客户端,而非生成完整内容后一次性返回;

- 对比传统输出:传统输出是 “等待→一次性接收”,流式输出是 “边生成→边接收”;

- 核心优势:提升用户体验(减少等待感)、适配实时对话场景(如 ChatGPT 聊天框)、降低服务端内存压力;

- 技术要点:基于 HTTP 协议,单方向从服务端到客户端,支持持续数据传输,前端可实时渲染每一段输出内容。

Prompt Engineering(提示词工程)【必学】

1. 什么是 Prompt(提示词)

Prompt 是用户向大模型发出的指令 / 问题 / 提示信息,是大模型的 “输入依据”,本质是通过自然语言 / 结构化语言,引导大模型按预期完成任务(回答、创作、推理等)。

- 形式:可简单可复杂,简单如 “什么是 LLM?”,复杂如 “作为 Java 后端讲师,用通俗的语言讲解 RAG,分 3 点,每点配 1 个实际开发案例”;

- 核心:让大模型精准理解用户意图,是发挥大模型能力的关键,好的 Prompt 能大幅提升输出质量。

2. Prompt 的编写技巧

核心原则:清晰、具体、结构化、定角色,避免模糊、笼统的表述,以下是实操性技巧:

- 角色设定:给大模型指定具体角色,贴合任务场景(如 “作为资深 Java 架构师”“作为小学三年级语文老师”);

- 任务描述:明确要做什么、输出形式、篇幅、风格(如 “写一篇 200 字的产品文案,风格活泼,适合小红书”);

- 约束条件:明确禁忌、限制(如 “不使用专业术语”“分点作答,每点不超过 50 字”);

- 结构化输入:用序号、分号、标题等让 Prompt 条理清晰,大模型更易识别逻辑;

- 反向示例:若有明确不想要的结果,可给出反例(如 “不要写成说明文,避免如下表述:xxx”);

- 简洁性:在清晰的前提下,减少冗余信息,避免占用过多 Token。

3. Few-shot Learning(少样本学习)

- 定义:一种大模型的使用方式,指在 Prompt 中给出少量(1-5 个)“问题 – 答案” 的示例,让大模型模仿示例的逻辑 / 格式完成同类任务,无需额外训练;

- 核心:利用大模型的泛化能力,通过少量示例传递任务规则,解决 “零样本(无示例)下输出格式 / 逻辑不符预期” 的问题;

- 适用场景:格式固定的任务(如数据提取、分类、格式化输出);

- 示例:任务是 “将水果名称按‘中文 – 英文’格式整理”,Prompt 中给出示例:1. 苹果 – Apple 2. 香蕉 – Banana,再让模型整理 “橙子、葡萄”。

4. Chain of Thought(思维链,COT)

- 定义:一种提升大模型逻辑推理能力的 Prompt 技巧,指在 Prompt 中引导大模型分步、逐步地展示推理过程,而非直接给出答案,让模型按 “思考步骤” 推导结果;

- 核心:契合人类的推理习惯,将复杂问题拆解为简单子问题,减少大模型的推理错误,尤其适用于数学计算、逻辑分析、问题求解等场景;

- 分类:

- 零样本 COT:仅在 Prompt 中加入引导语(如 “请分步思考,写出你的推理过程,最后给出答案”);

- 少样本 COT:在 Prompt 中给出 “问题 – 分步推理 – 答案” 的示例,让模型模仿;

- 示例:任务是 “36+78-29=?”,引导语后模型输出:第一步,计算 36+78=114;第二步,计算 114-29=85;答案:85。

三、RAG 检索增强生成【必学】

1. 什么是 RAG

RAG 是检索增强生成(Retrieval-Augmented Generation) 的简称,是一种结合 “信息检索” 和 “大模型生成” 的技术方案,核心解决大模型知识截止、幻觉、专业知识不足三大痛点。

- 本质:大模型生成答案前,先从外部私有知识库 / 海量文档中检索与问题相关的信息,再基于检索到的精准信息 + 自身通用知识生成答案,而非仅靠模型自身训练的知识;

- 核心价值:

- 无需重新训练大模型,低成本更新知识(适配最新信息 / 私有知识);

- 减少幻觉,让答案有事实依据(可追溯到检索的文档);

- 提升专业领域问题的回答准确性(如企业内部文档、行业论文、产品手册)。

2. RAG 的工作流程

RAG 分为离线构建知识库和在线问答两个核心阶段,整体流程共 6 步,环环相扣:

阶段 1:离线构建知识库(一次性操作,可更新)

- 文档采集:收集需要接入的文本数据(企业手册、论文、PDF、网页、Excel 等);

- 文档预处理:对原始文档进行清洗(去水印、去冗余、格式转换)、切分(将长文档拆分为短文本片段,适配模型窗口);

- 向量化编码:通过Embedding 模型将每个文本片段转换为向量(Embedding Vector)(计算机能理解的数值序列);

- 向量入库:将生成的向量与对应的文本片段关联,存入向量数据库,建立索引。

阶段 2:在线问答(用户每次提问都执行)

- 问题检索:将用户的问题通过同一 Embedding 模型转换为向量,在向量数据库中按相似度匹配,检索出与问题最相关的 Top-N 文本片段;

- 生成答案:将检索到的文本片段作为上下文信息,与用户问题拼接成 Prompt,输入大模型,大模型基于这些精准信息生成答案,并可标注信息来源。

3. 向量数据库(Embedding)

(1)Embedding(嵌入 / 向量化)

- 定义:将非结构化数据(文本、图片、音频) 转换为高维稠密向量的过程,转换后的向量能表征数据的语义信息——语义越相似,向量的距离越近;

- 核心:Embedding 模型是 RAG 的核心组件,需与大模型适配(如中文场景用通义千问 Embedding、ChatGLM Embedding),避免语义表征偏差;

- 示例:“苹果是水果” 和 “香蕉是水果” 的向量距离,远小于 “苹果是水果” 和 “汽车是交通工具” 的向量距离。

(2)向量数据库

- 定义:专门用于存储、索引、检索向量的数据库,区别于传统关系型数据库(MySQL、PostgreSQL),核心支持相似度检索;

- 核心能力:高效的近邻检索(如余弦相似度、欧氏距离)、海量向量的快速查询、向量的增删改查;

- 主流产品:

- 开源:Milvus、Chroma、Pinecone(开源版)、FAISS(Facebook 的检索库);

- 商用:阿里云向量数据库、腾讯云向量数据库、Pinecone(云服务);

- 传统数据库扩展:PostgreSQL+pgvector 插件(轻量场景适配)。

4. 文档切分和索引

(1)文档切分

RAG 的核心关键步骤(直接影响检索和生成效果),指将长文档拆分为短的、语义完整的文本片段(称为 “Chunk”)。

- 切分原则:语义完整性优先,长度适配模型窗口—— 避免将一个完整的知识点拆分为多个 Chunk,同时 Chunk 长度不宜超过 Embedding 模型的最大处理长度;

- 常用方法:

- 固定长度切分:按固定 Token / 字符数切分(如 512Token / 个),简单易操作,适合结构化文档;

- 语义切分:按段落、标题、标点(如句号、分号)切分,结合语义边界,适合非结构化文档(如论文、书籍);

- 重叠切分:切分后的相邻 Chunk 保留一定重叠部分(如 100Token),避免语义断裂;

- 切分粒度:一般建议 200-1000Token/Chunk,需根据实际场景调优。

(2)索引

- 定义:为向量数据库中的向量建立检索索引,目的是提升相似度检索的速度,避免海量向量下的全量遍历(效率极低);

- 主流索引算法:HNSW(分层导航小世界,最常用)、IVF(倒排文件)、FAISS 的 IVF_FLAT 等;

- 核心:索引是 “以空间换时间”,需在检索速度和检索精度之间做平衡(索引越复杂,速度越慢,精度越高)。

四、AI Agent【建议学】

1. 什么是 AI Agent

AI Agent 是人工智能智能体的简称,是基于大模型的高阶应用形态,指一个能自主感知环境、理解任务、制定计划、调用工具、完成目标的智能系统,区别于大模型的 “被动响应”,AI Agent 具备主动性和自主性。

- 核心定位:大模型是 “大脑”,AI Agent 是 “大脑 + 手脚 + 决策系统”,让大模型从 “只会回答问题” 升级为 “能独立解决复杂问题”;

- 简单理解:把 AI Agent 看作一个自主工作的 “员工”,你只需给出 “目标”(如 “写一篇 Java 后端 RAG 实战的技术博客”),它会自主拆解任务、找资料、写内容、优化,无需你分步指令。

2. Agent 的核心能力

AI Agent 的核心是 **“大模型 + 工具 + 推理”** 的结合,两大核心能力缺一不可:

(1)工具调用(Tool Use)

- 定义:AI Agent 能识别任务需求,自主选择并调用外部工具,弥补大模型自身的能力短板(如实时信息、数据计算、专业操作);

- 核心逻辑:大模型通过 Prompt 判断 “是否需要调用工具”“调用哪个工具”“传入什么参数”,工具执行后返回结果,大模型再基于结果继续处理;

- 主流工具类型:

- 信息检索:百度 / 谷歌搜索、API 接口(如天气、股票);

- 数据计算:Excel、Python、计算器、SQL 查询;

- 专业操作:代码运行、画图工具、文档处理、邮件发送;

- 业务系统:企业内部 CRM、ERP、数据库;

- 技术要点:需为工具定义清晰的描述(功能、入参、出参),让大模型能精准识别工具的适用场景。

(2)多步推理(Multi-step Reasoning)

- 定义:AI Agent 能将复杂的单一目标,自主拆解为多个可执行的子任务,并按合理的顺序依次执行,最终完成总目标,是 Agent “自主性” 的核心体现;

- 核心逻辑:基于大模型的 COT 能力,结合任务目标,不断 “思考 – 拆解 – 执行 – 反馈 – 调整”,解决 “单步指令无法完成的复杂问题”;

- 示例:目标是 “分析 2025 年 Java 后端就业趋势,写一份 500 字的报告”,Agent 的推理步骤:1. 调用搜索引擎检索 2025 年 Java 后端就业相关数据;2. 检索 Java 后端主流技术栈的招聘需求;3. 整理检索到的核心信息;4. 按 “趋势 + 原因 + 建议” 的结构撰写报告;5. 优化报告语句,控制字数。

3. Multi-Agent 协作

(1)什么是 Multi-Agent

Multi-Agent 是多智能体协作,指将多个不同功能的 AI Agent 组合起来,每个 Agent 负责一个专属领域 / 任务,通过相互沟通、协作、分工,完成单一 Agent 无法解决的超复杂目标,核心是 “分工协作,优势互补”。

- 核心类比:像一个企业团队,有产品经理 Agent、开发工程师 Agent、测试工程师 Agent、运营 Agent,共同完成一个产品开发项目;也像一个科研团队,有文献检索 Agent、数据分析 Agent、论文撰写 Agent,共同完成一篇科研论文。

(2)Multi-Agent 核心协作模式

主流协作模式基于 “角色分工” 和 “任务流转”,以下是 3 种最常用的模式,可组合使用:

- 流水线模式(Pipeline)

- 逻辑:按固定的任务顺序,将总目标拆分为多个子任务,每个 Agent 负责一个子任务,上一个 Agent 完成后,将结果传递给下一个 Agent,直到完成总目标;

- 特点:流程固定、简单易实现,适合有明确执行顺序的任务(如写论文、做产品文案);

- 示例:写技术博客→素材检索 Agent→内容创作 Agent→排版优化 Agent→审核校对 Agent。

- 主从模式(Master-Slave)

- 逻辑:设置一个主 Agent(Master) 和多个从 Agent(Slave);Master 负责拆解总目标、分配子任务、协调进度、整合结果;Slave 负责执行具体的子任务,并将结果返回给 Master;

- 特点:主 Agent 统一调度,从 Agent 专注执行,适合任务拆解灵活、需要全局协调的复杂任务(如项目规划、数据分析报告);

- 示例:电商活动策划→Master Agent(拆解任务:选品、定价、文案、推广)→Slave Agent(选品 Agent、定价 Agent、文案 Agent、推广 Agent)→Master Agent(整合所有方案,形成最终策划案)。

- 辩论模式(Debate)

- 逻辑:多个 Agent 围绕同一个问题 / 目标,从不同角度提出观点、分析方案、互相辩论,最终由一个裁判 Agent整合所有观点,形成最优解;

- 特点:多视角分析、结果更全面,适合需要深度思考、多方案对比的任务(如战略规划、风险评估、产品设计);

- 示例:产品功能设计→设计 Agent A(主打实用性)、设计 Agent B(主打体验感)、设计 Agent C(主打低成本)→互相辩论各方案的优劣→裁判 Agent(整合最优方案,平衡实用性、体验感、成本)。

(3)Multi-Agent 协作的核心要点

- 角色精准定位:每个 Agent 的功能 / 领域要单一且专业,避免角色重叠,发挥优势互补;

- 清晰的沟通协议:Agent 之间需有统一的信息交互格式(如结构化的消息体),确保信息传递准确、无歧义;

- 任务边界清晰:明确每个 Agent 的任务范围、输入 / 输出要求,避免任务推诿或重复执行;

- 全局协调机制:需有 “主 Agent” 或 “调度系统”,把控整体进度,处理协作中的冲突(如多个 Agent 的结果矛盾);

- 反馈闭环:子任务执行结果需及时反馈给上游 / 主 Agent,便于调整后续任务执行策略。

(4)Multi-Agent 主流应用场景

- 复杂内容创作:书籍撰写、影视剧本创作、多平台内容矩阵运营;

- 企业项目管理:产品开发、市场策划、供应链优化;

- 科研与数据分析:科研论文撰写、海量数据挖掘与分析、行业报告制作;

- 智能客服:多领域客服协作(售前、售中、售后、技术支持);

- 智能制造:工厂生产调度、设备维护、工艺优化。